AIの複雑なデータ分析能力を評価する新ベンチマーク「AIDABench」が発表

要約

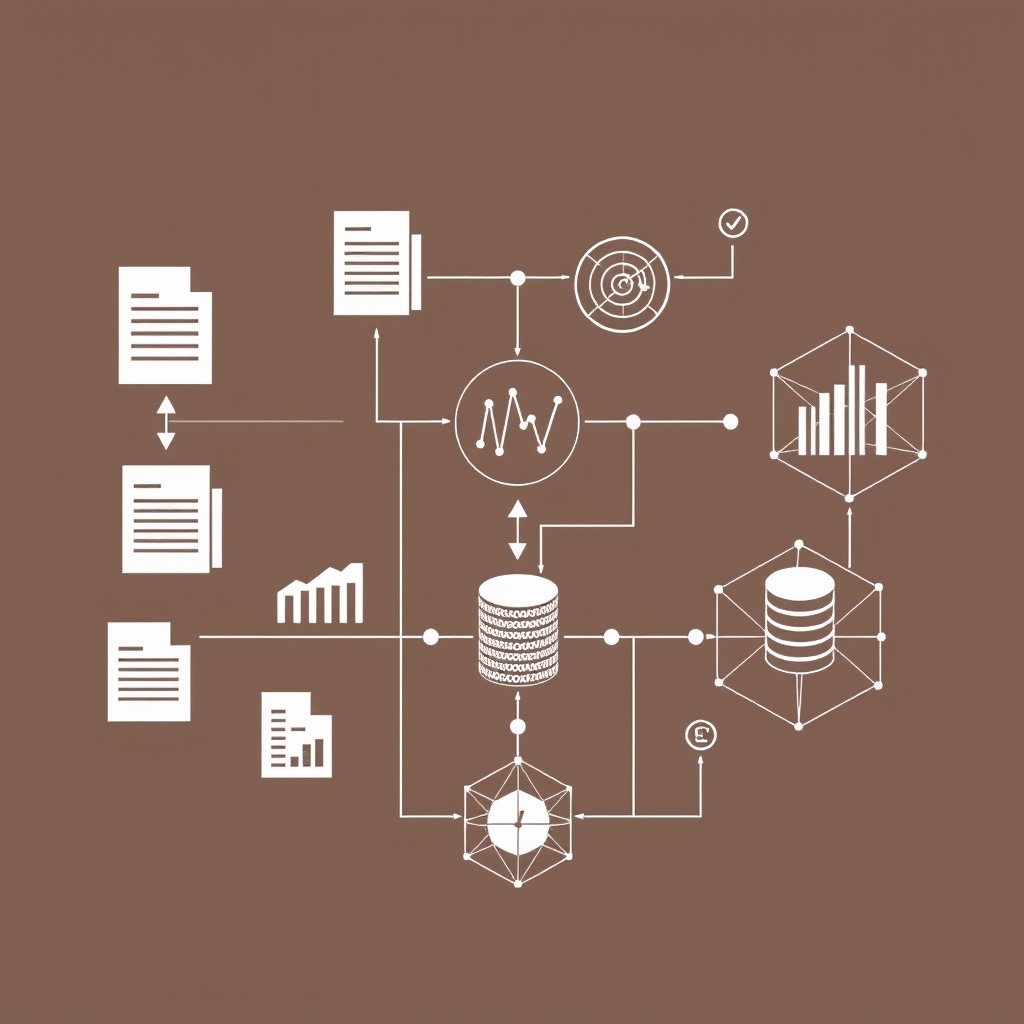

AI駆動の文書理解・処理ツールが実世界で広く使用されるようになる中、研究者らは既存の評価基準では実用的な設定で必要なエンドツーエンドタスクの効果を適切に測定できないという課題を特定しました。この問題を解決するため、複雑なデータ分析タスクにおけるAIシステムを包括的に評価する新しいベンチマーク「AIDABench」が開発されました。AIDABenchは600以上の多様な文書分析タスクを含み、質問応答、データ可視化、ファイル生成という3つのコア能力次元で評価を行います。これらのタスクは、スプレッドシート、データベース、財務報告書、運営記録などの異種データタイプを使用した現実的なシナリオに基づいており、様々な業界や職能の分析需要を反映しています。このベンチマークの難易度は極めて高く、人間の専門家でもAIツールの支援を受けて1問あたり1-2時間を要するほどです。研究チームは、Claude Sonnet 4.5やGemini 3 Pro Preview等のプロプライエタリモデルから、Qwen3-Max-2026-01-23-Thinkingなどのオープンソースモデルまで、11の最先端モデルでAIDABenchを評価しました。結果として、最高性能のモデルでもpass-at-1で59.43%という成績にとどまり、複雑な実世界データ分析タスクが現在のAIシステムにとって依然として大きな挑戦であることが明らかになりました。

洞察・気づき

AIDABenchの登場は、AI評価における重要な転換点を示しています。従来のベンチマークが単純化されたタスクや個別機能に焦点を当てていたのに対し、この新しい評価基準は実世界の複雑さを反映した包括的な評価を提供します。最先端モデルでも60%未満の成績という結果は、現在のAI技術がまだ人間レベルの複雑な分析作業に達していないことを示しており、特に異種データの統合、長時間の推論、複数ステップの分析プロセスにおいて改善の余地があることを浮き彫りにしています。企業にとっては、AI導入時のツール選択や期待値設定において重要な指標となり、研究者にとっては今後の開発方向性を示す羅針盤となるでしょう。また、人間専門家でもAI支援で数時間を要するタスクという設定は、AIと人間の協働における新しい評価パラダイムを提示しており、今後のAI開発がより実用的で現実に即した方向に進むことを促進するものと期待されます。